08 дек. 2025 г.·8 мин

Основы работы браузера: без мифов, чтобы AI-фронтенд не ломался

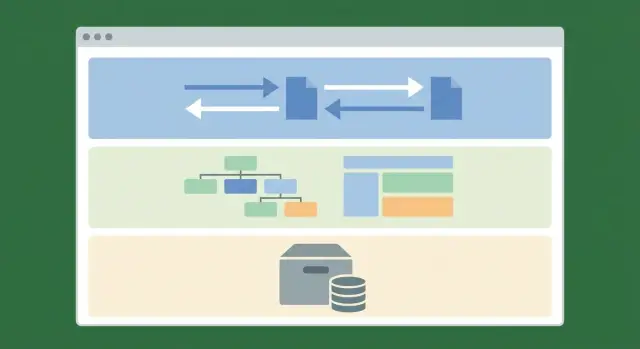

Понимая основы работы браузера, вы быстрее находите причины багов в AI-собранном фронтенде: сеть, рендер, кэш и типовые ловушки.

Почему фронтенды ломаются из-за мифов о браузере

Многие фронтенд-проблемы рождаются не из кода, а из уверенности в мифах о том, как работает браузер. Когда в команде спорят «это из-за React» или «браузер тупит», обычно не хватает простого шага: перейти от догадок к проверяемым фактам. Базовые принципы работы браузера полезны именно этим: они дают причины, которые можно увидеть и измерить.

Подход, который часто продвигает Джейк Арчибальд, приземленный: не спорить по памяти, а проверять в DevTools. Браузер уже показывает почти все: что ушло в сеть, что пришло, что закэшировалось, где ушло время, почему кадры проседают. Когда есть данные, «магии» становится меньше, а вместе с ней исчезают и типичные ошибки.

С AI-фронтендами это проявляется особенно ярко. Модель может звучать очень уверенно и при этом объяснять не то: «включи мемоизацию и все станет быстро», «кэш не при чем, это CDN», «у тебя race condition в рендере». AI часто предлагает популярный совет, а не реальную причину. Если вы собираете интерфейс через vibe-coding и быстро итерируете, такие подсказки легко принять за истину и закрепить проблему в архитектуре.

Часто путают симптомы, которые выглядят похоже, но лечатся по-разному. «Медленно загружается» обычно про сеть, размер ресурсов и блокирующие запросы. «Дергается при скролле» чаще связано с рендерингом, thrashing раскладки и тяжелыми стилями. «Не обновляется после правки» почти всегда упирается в HTTP-кэширование, service worker или сборку. «Ломается после деплоя» часто означает неверные заголовки кэша, разные версии ассетов или проблемы с путями. А «кликаю, а реакции нет» нередко сводится к длинным задачам в main thread, гидрации и обработчикам.

Хорошая новость: почти каждую из этих проблем можно подтвердить за пару минут, если смотреть не на ощущения, а на вкладки Network, Performance и Application. Это и есть способ перестать «чинить на удачу» и начать чинить причину.

Сеть простыми словами: как запрос становится страницей

Когда вы вводите адрес сайта и жмете Enter, браузер не «скачивает страницу одним файлом». Он проходит цепочку шагов, и в каждом месте можно потерять время или получить странный баг. Это особенно важно, когда фронтенд собран AI: он легко добавляет лишние запросы и «невидимые» зависимости.

Типичный путь запроса:

- DNS: браузер узнает, какой IP соответствует домену.

- TCP: устанавливает соединение с сервером.

- TLS: если HTTPS, делает шифрованное рукопожатие.

- HTTP: отправляет запрос (например, за HTML или JSON).

- Ответ: получает статус, заголовки и тело, после чего решает, что делать дальше.

TTFB (time to first byte) часто понимают неправильно. Это время до первого байта ответа, то есть «как быстро сервер начал отвечать». Но TTFB не равен скорости загрузки страницы. Страница может иметь отличный TTFB и все равно быть медленной, если после HTML нужно скачать десятки скриптов, шрифтов и картинок, а затем еще долго выполнять JavaScript.

Еще один частый миф: «много маленьких файлов всегда лучше, чем один большой». На практике важна цена каждого запроса: очереди, приоритеты, ограничение параллелизма и накладные расходы на заголовки. Современные протоколы помогают, но «россыпь» из 80 мелких модулей, идущих по цепочке, может проиграть одному нормально собранному бандлу, особенно если часть ресурсов блокирует запуск.

CDN часто воспринимают как кнопку «сделать быстро». Он действительно приближает статические файлы (картинки, JS, CSS) к пользователю и снижает задержку, но не решает все. Фронтенд все равно должен не тянуть лишнее при старте, не строить водопад запросов из-за неудачного разбиения кода, правильно выставлять заголовки кэширования и версионировать ассеты, а также не блокировать рендер большим JS до появления первого полезного контента.

Простой пример: AI собрал React-страницу и вынес в отдельные файлы десятки компонентов, каждый со своим импортом и динамической загрузкой. В итоге TTFB хороший, но «пустой экран» держится долго, потому что сеть занята очередью скриптов. Если понимать, как запрос становится страницей, вы проверите порядок загрузки, число критических запросов и сократите зависимые цепочки, вместо того чтобы «лечить» проблему случайными правками.

Кэширование: почему изменения не видны и как это чинить

Кэширование - это не «браузер что-то не так делает», а попытка сэкономить время и трафик. Если понимать основы, многие странные баги после выкладки перестают быть загадкой: вы просто видите, где именно «застряла» старая версия.

Важно различать два слоя. Кэш браузера хранит файлы у пользователя (JS, CSS, картинки) и решает, нужно ли идти в сеть. Серверный кэш (CDN, прокси, балансировщик, само приложение) может отдавать старый ответ, даже если браузер уже готов обновиться. Поэтому «не вижу изменения» часто вообще не про фронтенд.

Заголовки, которые решают судьбу обновлений

Поведение задают HTTP-заголовки. Самое важное:

- Cache-Control - главный регулятор. Для фронтенд-сборок обычно работает простое правило: файлы с хэшем в имени кэшировать надолго, а HTML кэшировать минимально.

- ETag и Last-Modified - позволяют «проверить свежесть» без полной скачки. Браузер отправляет условный запрос и может получить 304 Not Modified.

- Vary - говорит, от чего зависит ответ. Если забыть про Vary (например, по Accept-Encoding или языку), легко получить «перемешанные» версии для разных условий.

На AI-сборках здесь особенно легко ошибиться: модель может предложить «кэшировать все на год», и вы реально зафиксируете пользователям старый index.html, который тянет уже несуществующие бандлы.

Почему Hard Reload иногда помогает, а иногда нет

Hard Reload обычно сбрасывает часть кэша и заново скачивает ресурсы, но это не волшебная кнопка.

- Если старую версию отдает серверный кэш, перезагрузка не спасет.

- Если заголовки настроены неверно (например, HTML закэширован как immutable), браузер может упорно не обновляться.

- Если включен service worker, он может перехватывать запросы и отдавать свои копии.

Чтобы обновления фронтенда не «залипали», держите правило: HTML обновляется часто, статические файлы живут долго. Это достигается сочетанием короткого TTL для HTML и файлов без хэша и долгого TTL для assets с хэшем.

Service worker полезен, когда нужен офлайн и быстрый старт, но типовые ошибки повторяются: кэшируют index.html без понятной стратегии обновления, забывают чистить старые кэши или не показывают пользователю, что доступна новая версия. В итоге после релиза часть людей продолжает жить на старом интерфейсе, и вы ловите «фантомные» баги.

Пример из практики: вы собрали React-приложение, выкатили новую сборку, а у пользователей белый экран. Частая причина - HTML остался старым, но JS-файлы уже новые (или наоборот). Решение почти всегда в стратегии кэширования и в том, чтобы гарантировать согласованную пару: свежий HTML всегда указывает на существующие бандлы.

Рендеринг: что происходит между HTML и пикселями

Когда браузер получил HTML, он еще не «показывает страницу». Он строит структуру и только потом рисует. Понимание этой цепочки быстро объясняет, почему интерфейс может дергаться или «прыгать».

Сначала HTML превращается в DOM (дерево элементов). Параллельно CSS превращается в CSSOM (правила стилей). Затем браузер объединяет их, вычисляет стили для каждого узла и делает layout - считает размеры и позиции. Дальше идет paint - рисование пикселей (текст, границы, тени). Последний шаг - compositing: сборка слоев и вывод на экран.

Тяжелые шрифты и большие изображения тормозят не только сеть. Шрифт влияет на размеры текста, а значит и на раскладку. Картинки нужно декодировать и иногда масштабировать, это грузит CPU и память. Если AI «для красоты» добавил несколько веб-шрифтов и огромные изображения без нужных размеров, вы получите задержку в отрисовке и рывки при прокрутке даже на быстром интернете.

Отсюда же берется layout shift (прыжки интерфейса). Типичный сценарий: карточки товара загружают изображения без заданных width/height, а баннер сверху появляется после запроса. Браузер сначала раскладывает блоки приблизительно, затем получает реальные размеры и пересчитывает layout. Кнопки уезжают, текст перескакивает, пользователь промахивается.

Анимации тоже зависят от того, что именно вы меняете. Некоторые свойства заставляют браузер пересчитывать layout и заново рисовать, и кадры начинают пропадать. Обычно плавнее, когда анимируются transform и opacity. А вот анимации width/height/top/left лучше избегать, если можно. Большие blur и box-shadow на крупных блоках тоже часто дают тяжелый paint. Помогает простая дисциплина: заранее выделять место под медиа и динамические блоки и не анимировать слишком много элементов одновременно.

Если вы собираете интерфейс в TakProsto и AI предложил «эффектные» анимации и медиа, проверьте в профиле, не вызывает ли это лишние перерасчеты и тяжелый paint. Часто достаточно заменить анимацию позиции на transform, задать размеры изображений и упростить тени, чтобы страница стала стабильнее и отзывчивее.

React и реальные причины медленной интерактивности

Соберите и задеплойте лендинг

Сделайте лендинг в чате и разверните его, чтобы быстро проверить поведение на проде.

Иногда страница уже «загрузилась»: верстка видна, но клик по кнопке не срабатывает пару секунд. Это не магия и не «React тормозит». Чаще всего браузер занят выполнением JavaScript и просто не успевает обработать ввод.

Самый частый виновник - большой JS-бандл. Визуально контент может появиться быстро (например, из HTML), но пока скачивается, парсится и выполняется тяжелый скрипт, главный поток занят. В итоге интерфейс «нарисован», но не интерактивен. Это часто случается в AI-собранных проектах, когда в бандл случайно попадают лишние библиотеки, икон-паки целиком или несколько UI-китов сразу.

Отдельная история - гидрация (когда React «подключает» обработчики к уже готовой разметке). Если разметка на сервере и на клиенте отличается, начинаются странности: предупреждения, мигающие блоки, обработчики работают через раз, появляются лишние перерисовки. Типовые источники - дата/время в рендере, случайные значения, чтение window/localStorage прямо во время рендера.

Лаги также дает состояние и эффекты. Когда компоненты часто меняют state, а useEffect запускает дополнительные обновления, React делает больше работы, чем нужно. AI нередко «лечит» это мемоизацией везде подряд (useMemo/useCallback), и код становится сложнее, а быстрее не становится. Мемоизация тоже стоит времени и памяти и не спасает от плохой структуры данных и лишних обновлений.

Практичный ориентир:

- Сначала измерьте: сколько времени уходит на выполнение JS и что блокирует главный поток.

- Найдите крупные зависимости и ненужный код в бандле.

- Проверьте гидрацию: нет ли несовпадений разметки и предупреждений.

- Упростите поток обновлений: меньше state, меньше эффектов, меньше «дерганий».

Пример: вы собрали лендинг в TakProsto, добавили анимации и пару виджетов, и кнопка «Оставить заявку» стала откликаться с задержкой. Часто решение не в «магических оптимизациях React», а в том, чтобы убрать тяжелую библиотеку, отложить второстепенные скрипты и сделать рендер предсказуемым (без случайных значений).

Пошаговая диагностика через DevTools без догадок

Когда AI собирает фронтенд (часто на React), он может выглядеть нормально, но «сыпаться» на реальных устройствах: то данные старые, то кнопка отвечает через секунду, то страница моргает при скролле. Быстрее всего вернуть контроль через DevTools и проверку по шагам.

Сначала сделайте проблему повторяемой. Запишите условия: браузер и устройство, скорость сети, вход под конкретным аккаунтом. Частая ловушка - тестировать на своем ноутбуке с теплым кэшем и быстрым интернетом, а у пользователя другой сценарий. Для чистоты попробуйте приватное окно или новый профиль, включите ограничение сети (например, «медленный 4G») и повторите действие 3-5 раз.

Дальше переходите в Network и ищите факты: какие запросы самые долгие, какие самые тяжелые по размеру, что именно грузится. Ошибка AI-фронтенда часто простая: вместо компактного JSON уходит огромный ответ, картинки приходят в исходном размере, или приложение делает 5 запросов подряд там, где нужен один.

Проверка обычно укладывается в понятную последовательность:

- В Network отсортируйте по времени и размеру и посмотрите топ-3 «виновника».

- Откройте самый долгий запрос и убедитесь, что тип ответа ожидаемый (HTML, JSON, изображение), а код ответа не прыгает между 200 и 304.

- Временно отключите кэш в DevTools и сравните поведение. Если «починилось», смотрите заголовки Cache-Control, ETag/If-None-Match, Expires.

- В Performance запишите профиль во время лагов. Ищите длинные задачи JS и частые пересчеты layout/style. Это выдает лишние перерисовки, тяжелые обработчики скролла, постоянные setState в цикле.

- Сверьте версию сборки: какая именно сборка на стенде и у вас локально. Сужайте изменения до одного шага: один коммит, один переключатель, один запрос.

Небольшой пример: вы быстро нагенерировали экран со списком и фильтром. Если на слабом телефоне фильтр «подвисает», Performance часто показывает длинные задачи из-за фильтрации большого массива прямо в рендере. Исправление обычно прямое: мемоизация по делу, перенос вычислений из рендера, виртуализация списка. Но это видно только в профиле, а не «на глаз».

Главная идея: каждый шаг должен либо подтвердить гипотезу, либо исключить ее. Так вы находите точную причину, а не лечите симптомы.

Частые ошибки в AI-собранных фронтендах

Кэширование без сюрпризов

Соберите фронтенд и отладьте Cache-Control и ETag, чтобы релизы не залипали.

AI может собрать рабочий интерфейс быстро, но часто делает это без понимания, как браузер реально грузит, рисует и хранит ресурсы. Если знать базовые принципы, многие проблемы видно заранее, еще до того как пользователи начнут жаловаться.

1) Слишком много запросов на старте

Симптом простой: первый экран появляется поздно, а в DevTools видно длинный водопад. AI охотно подключает несколько библиотек, шрифтов, иконок, аналитик и виджетов, и все это стартует одновременно. Проблема не только в количестве: часть запросов блокирует отображение (большой CSS, синхронные скрипты, цепочки редиректов, лишние DNS и TLS).

2) Кэш настроен «наоборот»

AI нередко ставит вечный кэш там, где он опасен (HTML), и отключает кэш там, где он выгоден (версионированные ассеты). Итог: вы выкладываете обновление, а пользователи видят старую страницу или получают смесь старого JS и нового API.

Нормальная практика сводится к одному правилу: HTML должен обновляться быстро, а файлы вида app.abc123.js можно кэшировать долго, потому что имя меняется при изменениях.

3) Инлайн стили и шрифты без контроля

AI может вставить крупные инлайн-стили, подключить несколько шрифтов и начертаний, добавить динамические вычисления размеров. Это приводит к лишним перерасчетам раскладки и заметным скачкам контента при загрузке.

Пример: на лендинге сначала показывается текст одним шрифтом, затем подгружается другой, и блоки «прыгают». Пользователь уже тянется к кнопке, а она уезжает.

4) Случайные re-render из-за эффектов и подписок

В React AI часто добавляет useEffect без стабильных зависимостей, создает функции на каждый рендер, подписывается на события и забывает отписаться. В итоге интерфейс «живет своей жизнью»: дергается, делает лишние запросы, а на слабых устройствах заметно тормозит.

5) Оптимизация ради оптимизации

Ранняя мемоизация (useMemo, memo) и усложнение состояния без причины повышают риск багов. Часто проще убрать лишние зависимости и стабилизировать данные, чем строить сложные схемы кэширования внутри компонентов.

Перед релизом полезна быстрая проверка: посмотрите водопад и критичный путь первого экрана, проверьте заголовки кэша отдельно для HTML и ассетов, оцените шрифты (сколько файлов и начертаний грузится), найдите эффекты, которые дергают запросы или подписки, и удалите «оптимизации», которые не дают измеримого эффекта.

Если вы собираете фронтенд через TakProsto, такие проверки особенно полезны сразу после генерации: AI быстро строит структуру, а вы добавляете дисциплину загрузки, кэша и рендера, чтобы приложение не ломалось в реальных браузерах.

Пример из жизни: как знания о браузере спасают релиз

Команда сделала промо-лендинг на React через чат в vibe-coding платформе. На тестовом Wi-Fi страница открывалась почти мгновенно, поэтому релиз уже был «на чемоданах». Но на проде начали жаловаться: первый клик по кнопке «Оставить заявку» отвечает с задержкой 1-2 секунды, иногда форма «подвисает». Типичная ловушка: кажется, что раз загрузка быстрая, то и сайт быстрый.

Проверили DevTools по шагам. В Network видно, что запросы приходят быстро, но браузер тянет слишком много фронтенд-ресурсов: несколько шрифтов, лишние скрипты аналитики, а главный JS-бандл заметно крупнее ожидаемого. Часть файлов кэшируется неправильно, поэтому повторный визит почти ничего не ускоряет.

Затем открыли Performance и записали сценарий «открыть страницу - кликнуть кнопку». Картина оказалась ожидаемой, если помнить основы работы браузера: длинные задачи на главном потоке блокируют обработчики кликов, а поздняя подгрузка изображений без заданных размеров вызывает пересчеты layout. В итоге браузер занят перерасчетом и перерисовкой, и интерактивность приходит позже, чем «видимая» загрузка.

Что сделали:

- Разбили загрузку: вынесли тяжелые части в ленивые чанки, а некритичные скрипты отложили.

- Ограничили шрифты: оставили один набор и включили понятную стратегию подгрузки.

- Задали размеры для картинок и баннеров, чтобы не было скачков верстки.

- Привели кэш к предсказуемой схеме, чтобы обновления реально доходили до пользователей.

После правок снова измерили. Время до интерактивности сократилось, длинных задач стало меньше, а клики перестали «залипать». Самое важное: команда перестала лечить симптомы. Понимание того, как работают сеть, рендеринг и кэш, снижает риск случайных регрессий, особенно когда интерфейс собран быстро и «как получилось».

Короткий чеклист перед выкладкой

Бэкенд и база вместе

Поднимите API на Go и базу PostgreSQL рядом с фронтендом, чтобы упростить отладку.

Перед релизом полезно на 10 минут переключиться из режима «собралось и работает» в режим «как это увидит пользователь». Знание основ работы браузера помогает проверять не ощущения, а конкретные вещи: сеть, кэш и путь до интерактивности.

Пройдитесь по списку на продакшн-сборке в обычном окне и в инкогнито (чтобы не обмануться старыми данными):

- Интерактивность за 3-5 секунд на среднем устройстве. Не только «первый экран появился», а можно ли нажимать, вводить, открывать меню. Если интерфейс «висит» после рендера, часто виноваты тяжелые скрипты, большой бандл или блокирующие запросы.

- Без прыжков макета при загрузке. У картинок и видео должны быть заданные размеры, у блоков с данными - стабильная высота (хотя бы через скелетон). Иначе пользователи промахиваются по кнопкам.

- Понятная стратегия кэша. Ассеты (JS, CSS, изображения) обычно должны жить долго и обновляться через версии файлов, а HTML - обновляться контролируемо.

- Короткий критичный путь на старте. На первом экране не должно быть десятков запросов. Все, что не нужно сразу (аналитика, редкие виджеты, второстепенные данные), лучше отложить до после интерактивности.

- Повторная загрузка реально быстрее. Обновите страницу второй раз и сравните. Если стало почти так же, кэш не работает или одинаковые данные дергаются заново.

Небольшой пример: AI собрал React-страницу с карточками товаров, но изображения без размеров. На быстром ноутбуке это почти незаметно, а на телефоне блоки скачут, и пользователь нажимает не туда. Исправление простое: задать размеры и зарезервировать место под контент до прихода данных.

Если вы собираете интерфейс в TakProsto, этот чеклист особенно полезен: AI может быстро сделать функционал, но финальное качество почти всегда определяется сетью, кэшем и стабильностью разметки.

Следующие шаги: как учиться и как встроить это в процесс

Знания про браузер не нужно превращать в отдельную «теорию ради теории». Важно, чтобы это стало частью ежедневной работы: проверили, измерили, объяснили причину, зафиксировали вывод.

Командный минимум удобно начать с DevTools. Не «уметь все», а уверенно читать базовые сигналы:

- Network: статус, размер, время, заголовки, кэш (from disk cache или memory cache)

- Performance: длинные задачи, что блокирует главный поток, когда наступает интерактивность

- Elements и Computed: почему стиль не применился, откуда взялось правило

- Application: Service Worker, Cache Storage, Local/Session Storage, почему «старое» не уходит

- Console: ошибки и предупреждения, и что именно было в моменте

Дальше важно договориться с AI о правилах. Просите не просто «сделай компонент», а объяснение причин: почему выбран такой подход, какие допущения сделаны (например, про кэш или порядок загрузки), и какие измерения подтвердят результат. Хорошая привычка: в каждом ответе AI должны быть хотя бы 1-2 проверки через DevTools (что открыть и какой сигнал увидеть).

Чтобы меньше переделывать, фиксируйте требования до генерации. В TakProsto для этого подходит режим планирования: сначала описываете ограничения (например, «критичный путь без лишних запросов», «обновления должны быть видны сразу», «без тяжелых эффектов при скролле»), а уже потом просите код. Так AI реже делает «красиво, но медленно».

Если нужен быстрый цикл экспериментов, удобно, когда платформа дает снапшоты и откат, экспорт исходников, деплой и хостинг. Это снижает страх пробовать варианты и помогает держать проект под контролем. У TakProsto (takprosto.ai) такие сценарии как раз и подразумеваются: быстро собрать версию через чат, а затем спокойно довести ее до качества через измерения и понятные правила.

План на 2 недели можно сделать простым: один навык в день и короткий разбор настоящего бага или замедления из вашего проекта.

- Дни 1-3: сеть (как формируется запрос, что в заголовках, где тратится время)

- Дни 4-6: кэш (HTTP-кэш, ETag, инвалидация, Service Worker и «почему не обновилось»)

- Дни 7-10: рендеринг (критический путь, layout/reflow, что вызывает перерисовки)

- Дни 11-13: производительность (long tasks, hydration, тяжелые зависимости, виртуализация списков)

- День 14: мини-ретро (3 частые причины, 3 проверки в DevTools, 3 правила для AI на будущее)

Если делать это регулярно, мифы исчезают сами: вы видите факты в инструментах, и ошибки в AI-собранных фронтендах становятся предсказуемыми, а значит исправимыми.